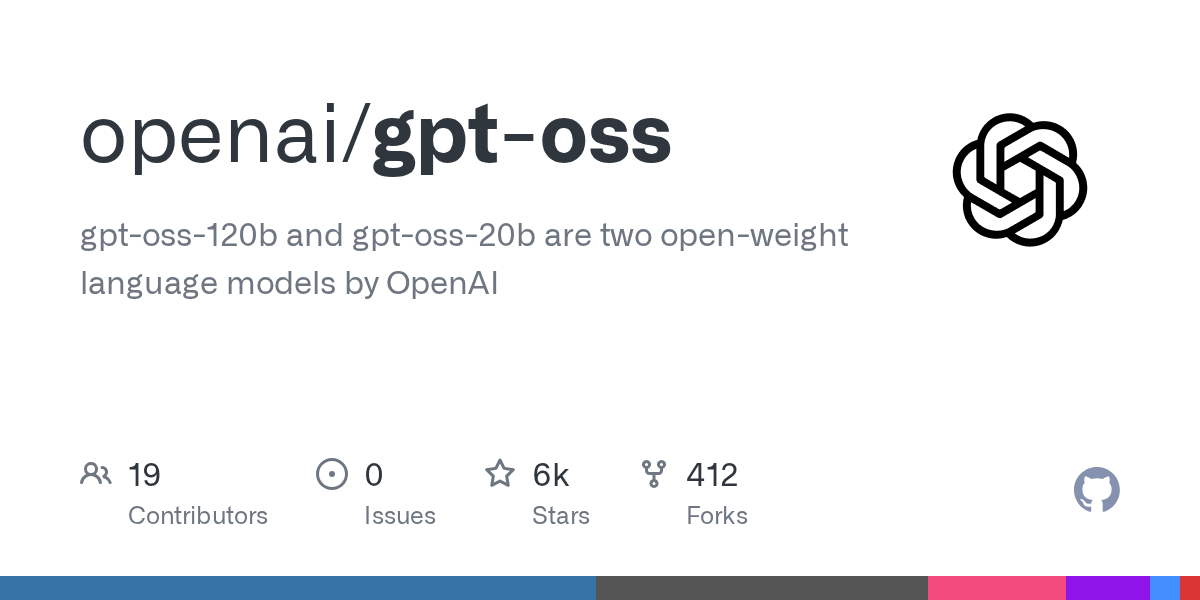

OpenAI sort des LLM open source : GPT-OSS

OpenAI annonce GPT-OSS, un LLM open source sous licence Apache 2. Il s'agit d'une annonce importante pour OpenAI car il s'agit du premier LLM ouvert depuis GPT-2. Deux modèles sont proposés : 120 milliards de paramètres et 20 milliards. GPT-OSS-120b nécessite une puissance GPU et 80 Go de RAM, le modèle 20b se veut comparable au modèle 03-mini et se contente de 16 Mo de RAM pour tourner. Idéal pour une machine locale. Pour OpenAI, GPT-OSS est un bon compromis pour de l'inférence local avec une capacité de traitement acceptable. Ces modèles sont compatibles avec les API Responses et sont utilisables avec les flux agentiques, les projets Python, etc.

Ils sont disponibles sur Hugging Face. Ils fonctionnent avec PyTorch et supportent Metal d'Apple. On peut utiliser des plateformes et outils tels que Azure, Hugging Face, vLLM, Ollama, llama.cpp, LM Studio, AWS, Fireworks, Together AI, Baseten, Databricks, Vercel, Cloudflare. Il supporte nativement MXFP4.

Pour l'utiliser, OpenAI recommande Python 3.12, Xcode CLI tools sur macOS, CUDA sur Linux. Attention : le support Windows n'a été officiellement testé.

Installation via PyPi :

# if you just need the toolspip install gpt-oss# if you want to try the torch implementationpip install gpt-oss[torch]# if you want to try the triton implementationpip install gpt-oss[triton]

Annonce et benchmarks : https://openai.com/index/introducing-gpt-oss/

GitHub : https://github.com/openai/gpt-oss

En partenariat avec le magazine Programmez!, www.programmez.com